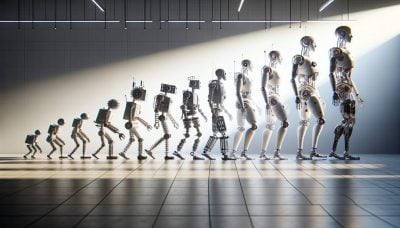

Vitalik Buterin advierte sobre los peligros de la IA superinteligente

Buterin aboga por un enfoque cauteloso en el desarrollo de la IA, centrándose en modelos abiertos y accesibles.

Compartir este artículo

El cofundador de Ethereum, Vitalik Buterin, advirtió sobre el rápido desarrollo de la inteligencia artificial (IA), particularmente la IA superinteligente. Cree que un tipo hipotético de IA que supera la inteligencia humana en todos los aspectos representa un peligro significativo.

«La IA superinteligente es muy arriesgada y no deberíamos precipitarnos,» dijo Buterin en una publicación reciente en X.

También criticó la propuesta de Sam Altman de invertir $7 billones en una super granja de semiconductores para IA.

Según un informe de febrero del WSJ report, el CEO de OpenAI buscó asegurar entre $5 billones y $7 billones para aumentar la capacidad mundial de producción de chips avanzados diseñados específicamente para IA. La actual escasez de estos chips se ve como un cuello de botella para el desarrollo de la IA, incluyendo los proyectos de OpenAI.

Aparte de los posibles riesgos de la IA superinteligente, las preocupaciones de Buterin se centran en los peligros de la concentración de poder. Aboga por un ecosistema de IA descentralizado, promoviendo un enfoque en modelos de IA de código abierto que funcionen en hardware de consumidor regular.

Este enfoque se considera una alternativa más segura a la IA altamente concentrada controlada por unas pocas entidades poderosas. Los modelos abiertos también se consideran menos propensos a representar una amenaza existencial que la IA controlada por corporaciones.

«Un fuerte ecosistema de modelos abiertos funcionando en hardware de consumidores es un importante resguardo para proteger contra un futuro donde el valor capturado por la IA es hiper-concentrado y la mayoría del pensamiento humano es leído y mediado por unos pocos servidores centrales controlados por unas pocas personas. Tales modelos también son mucho más bajos en términos de riesgo de catástrofe que tanto la megalomanía corporativa como los militares,» añadió.

El cofundador de Ethereum también expresó su apoyo a distinciones regulatorias entre modelos de IA «pequeños» y «grandes». Sin embargo, Buterin mostró preocupación de que un exceso de regulación de la IA podría empujar inadvertidamente todo hacia la categoría «grande» con el tiempo, dificultando el desarrollo de una IA abierta y accesible.